Sobre Mim

Yasmim Abrahão

Engenheira de dados

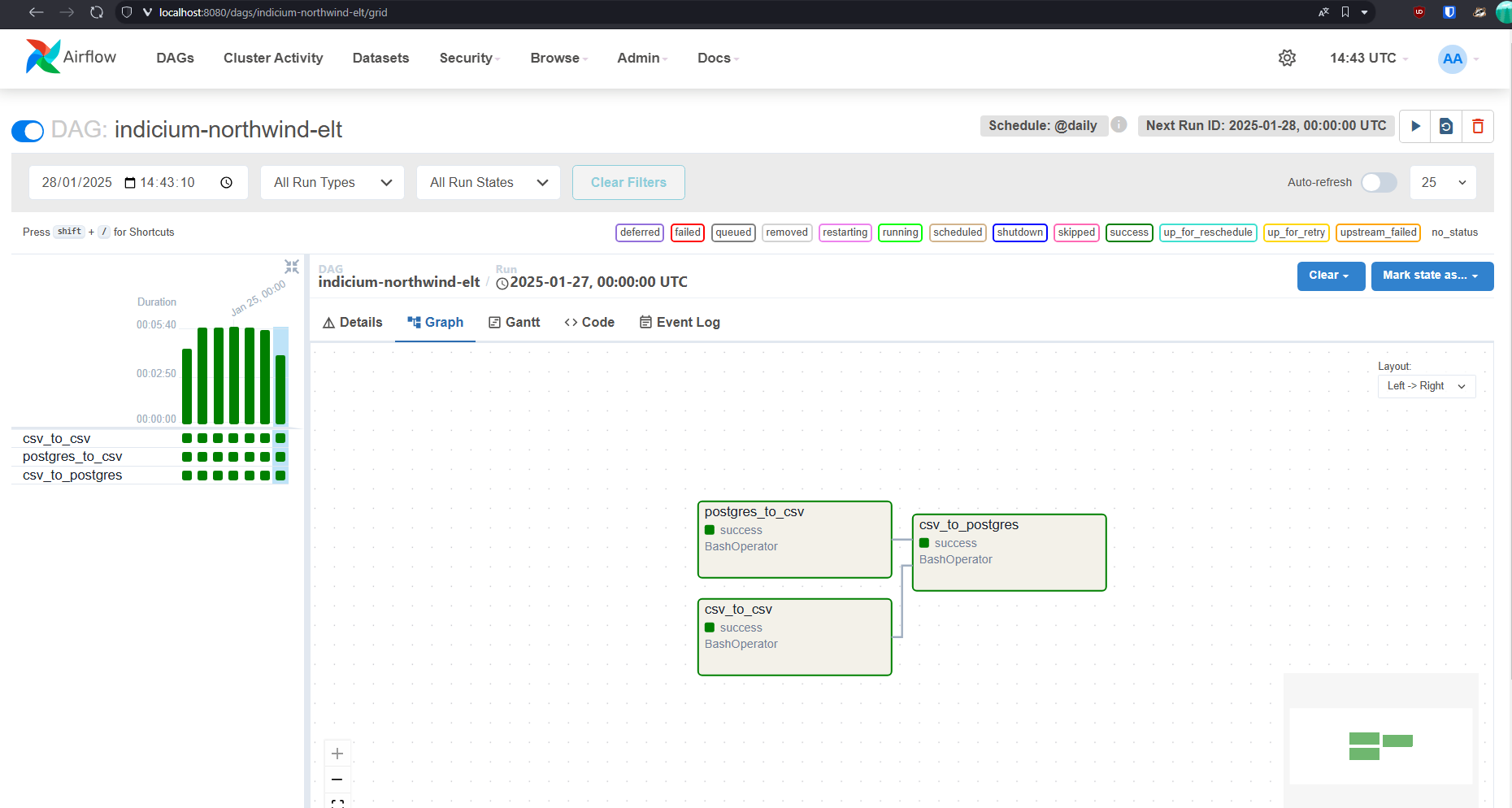

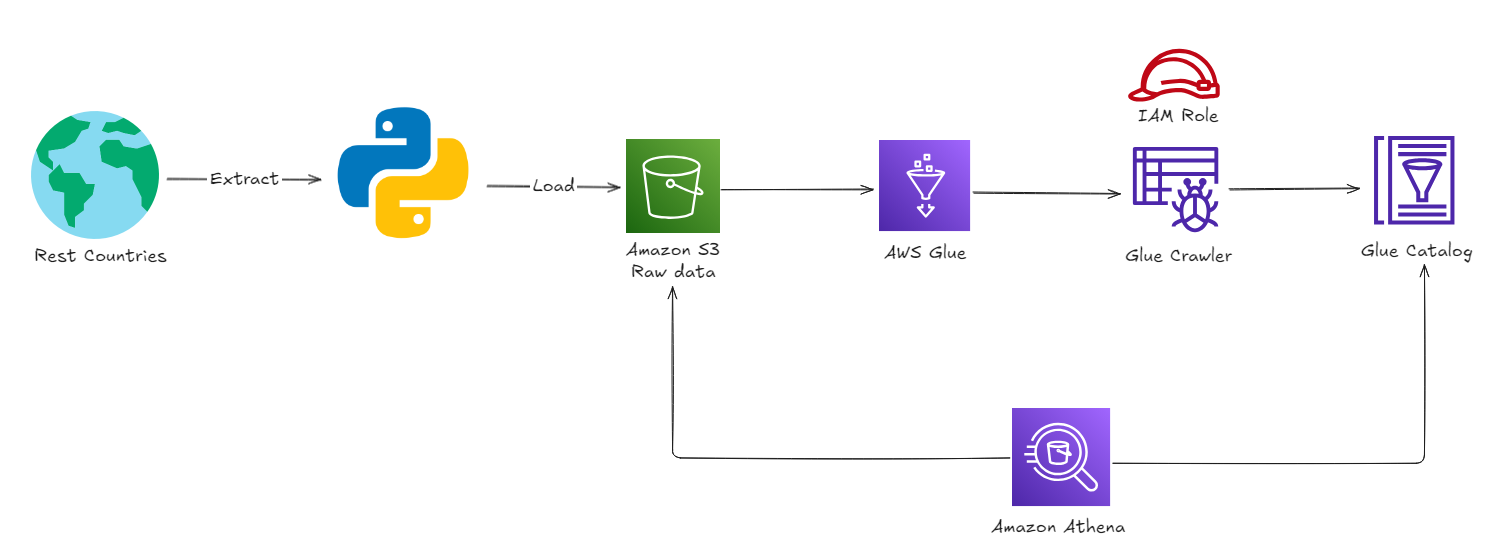

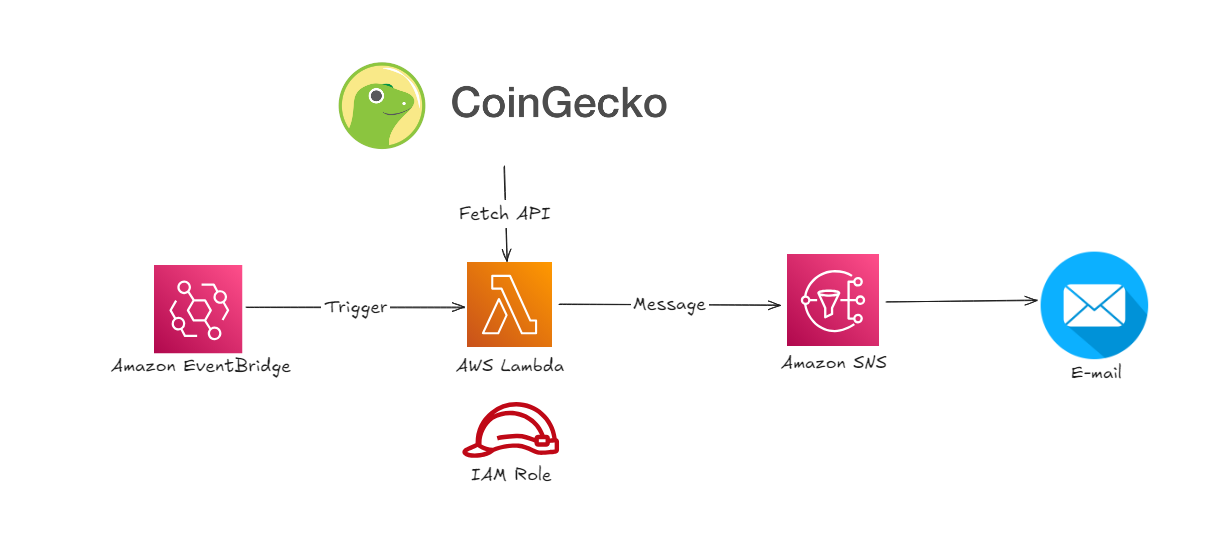

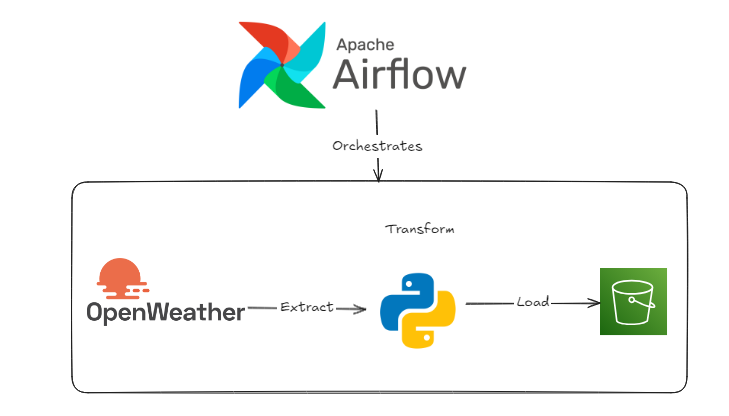

Sou apaixonada por tecnologia, sempre em busca de aprender mais e transformar dados em soluções inteligentes. Atualmente estudo Sistemas de Computação na Universidade Federal Fluminense e, desde cedo, percebi o poder dos dados em moldar decisões. Atualmente, atuo como Assistente de BI na Licks Attorneys, onde crio dashboards interativos em Power BI e desenvolvo pipelines de dados em Python, conectando e manipulando informações com SQL e APIs. Meu maior objetivo é trabalhar como Engenheira de Dados, aplicando tudo o que aprendi em integrações e automações, ajudando empresas a escalar suas operações e tomar decisões mais estratégicas.

Download CV